Part 1 · Ralphthon

AI가 밤새 코딩하고,

03

AI Builders #4

AI가 밤새 코딩하고,

사람은 잠을 잔 1박 2일

서울 · 에어비앤비 · 2026. 2. 28–3. 1

큰 단위의 작업을 끝까지 완수하기 위한

Long-Running Codex 활용 방식과 시행착오

정구봉 · 2026-03

| Part | Time | Content |

|---|---|---|

| Part 1 | 5min | Ralphthon — Seoul에서 열린 장기 자율 에이전트 해커톤 |

| Part 2 | 10min | Harness Engineering — 복잡한 하네스가 이긴 이유 |

| Part 3 | 10min | Code Factory — 조직 차원의 Long-Running 도입 |

AI Builders #4

서울 · 에어비앤비 · 2026. 2. 28–3. 1

스폰서: 카카오벤처스 (장소/식사/촬영) + OpenAI (상금/API 크레딧)

실제 가재옷 착용 장면

| Project | Team | LOC | Done | Prize |

|---|---|---|---|---|

| houseops | 이재규, 정승아 | 169,553 | 95% | 1위 $10K |

| cyberthug-screenclone | 허예찬, 하도윤 | 45,522 | 85% | 2위 $5K |

| sansa | 황성현 | 8,483 | 85% | 3위 $3K |

| tonica | 김우영 | 122,028 | 97.6% |

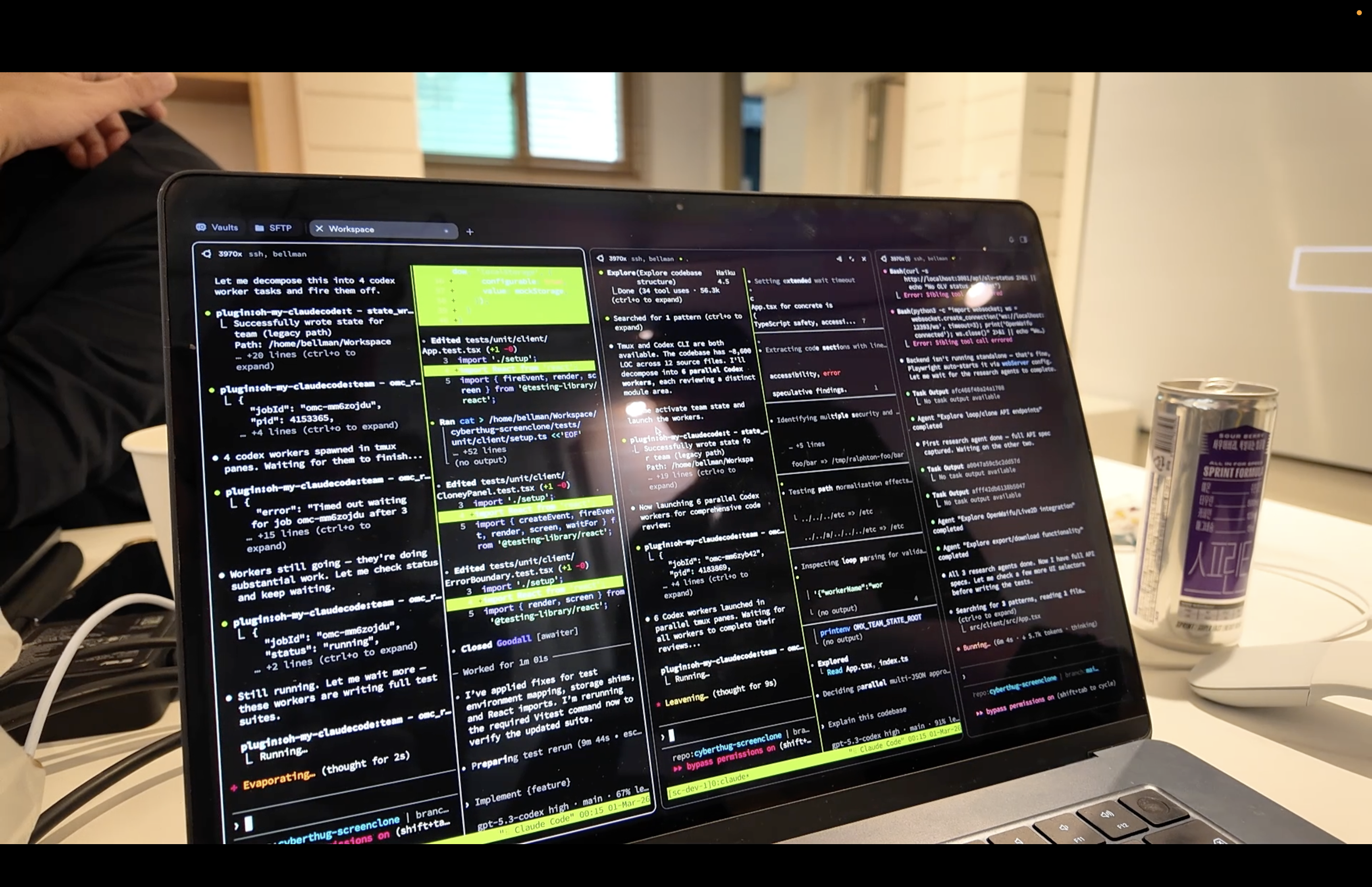

밤새 자율 코딩 환경

왜 초기 Ralph만으로는 큰 작업을 끝낼 수 없는가

| Complex Harness (1, 2위) | Simple Harness | |

|---|---|---|

| 루프 구조 | 세대별 진화, 스펙 자체가 변화 | 고정 스펙을 순차 실행 |

| 상태 관리 | Event Sourcing, 크래시 복구 | 없음 또는 watchdog |

| 평가 | 다단계 (기계적→의미적→합의) | Pass/Fail 단일 판정 |

| 종료 조건 | 수학적 수렴 (유사도 ≥ 0.95) | 고정 횟수 |

| 결과 | 1등 169K LOC, 2등 45K LOC | — |

github.com/Q00/ouroboros · 1등 houseops

핵심: 스펙 자체를 진화시키는 루프

고정된 스펙을 반복하는 하네스는 코드베이스가 수만 줄을 넘으면 drift가 벌어진다.

진화형 하네스는 매 세대마다 간극을 감지하고 스펙 자체를 수정한다.

github.com/Yeachan-Heo/oh-my-codex · 1.7K+ stars · 2등 cyberthug

조직 차원의 Long-Running 도입

Ralph를 “Long Running Harness”라고 부르지만,

한 세션은 언제든지 stop될 수 있습니다.

세션이 죽어도, 다음 세션이 이어받을 수 있는 구조가

진짜 Long Running입니다.

Ryan Carson · OpenAI Codex 팀: 5개월, 수동 코드 0줄, 100만 LOC, 엔지니어 1인당 3.5 PR/day

핵심: 에이전트가 코드를 100% 작성하더라도, 리포 자체가 정책을 강제하는 구조가 없으면 품질을 유지할 수 없다.

Andrew Chen: AI는 코드 컴파일처럼 객관적으로 검증 가능한 문제에 압도적으로 강하다.

“이 이메일이 무례한가?” 같은 주관적 판단에는 약하다.

Software Factory가 작동하는 이유:

소프트웨어 빌드는 객관적 검증이 가능한 영역이니까.

인간의 역할: “만드는 사람” → “방향을 잡는 사람”

Taste가 경쟁력이 되는 시대.

함께하고 있는 파트너

다양한 대기업·금융사·스타트업과 협업 중

Ralphthon Report: team-attention.com ·

Ouroboros: github.com/Q00/ouroboros ·

Oh My Codex: github.com/Yeachan-Heo/oh-my-codex

Ryan Carson's Code Factory ·

OpenAI Harness Engineering ·

Geoffrey Huntley (Latent Patterns) ·

Karpathy autoresearch ·

Andrew Chen

Team Attention — www.team-attention.com